霍金的人工智能警示 在数据海洋中航行,需谨慎掌舵

著名物理学家斯蒂芬·霍金曾多次在公开场合表达对人工智能(AI)发展的深切忧虑,他警告说,AI可能成为“人类历史上最糟糕的事件”,若不加控制,或将超越人类智能并最终威胁人类自身。这一预言在AI技术日新月异的今天,尤其是随着公共数据资源的爆炸式增长,显得尤为引人深思。

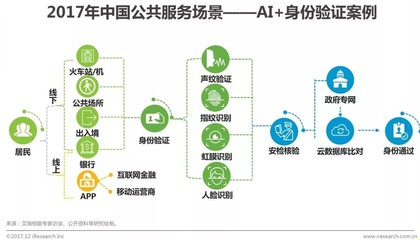

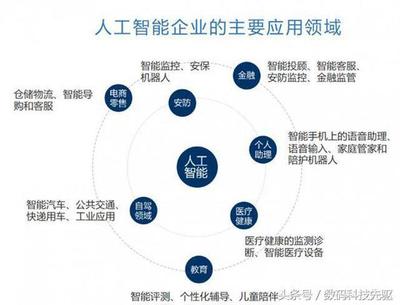

霍金的担忧并非空穴来风。人工智能的进步高度依赖数据,而公共数据作为其中最重要的“燃料”,正在驱动着从医疗诊断到自动驾驶、从金融分析到社交媒体的全面智能化。公共数据的开放性和庞大规模也带来了双重挑战:一方面,它加速了AI模型的训练与优化,使AI能够更好地服务于社会;另一方面,数据中的偏见、隐私泄露风险以及算法的不透明性,可能导致AI系统产生不可预测的后果,甚至被恶意利用。

具体而言,公共数据可能隐含社会不公、种族或性别歧视等问题,如果AI不加批判地学习这些数据,就可能放大现有偏见,加剧社会分裂。大规模数据收集往往涉及个人隐私,若保护不当,AI技术可能沦为监控工具,侵蚀个人自由。更深远的是,随着AI自主性增强,一旦其目标与人类利益冲突,缺乏有效监管的公共数据环境可能助长失控风险——这正是霍金所警示的“超越人类控制”的潜在场景。

霍金的预言会成真吗?答案并非简单的“是”或“否”。AI的未来很大程度上取决于人类如何管理和使用公共数据。如果我们能建立严格的伦理框架、健全的法律法规,并推动透明、可解释的AI系统,就能将风险降至最低。例如,通过数据脱敏技术保护隐私,利用算法审计消除偏见,并设立国际协作机制防止AI武器化。反之,若只顾短期利益而忽视长期风险,霍金的警告或将成为现实。

人工智能与公共数据的结合是一把双刃剑。它既承载着解决全球性问题的巨大潜力,也暗藏着不容忽视的威胁。霍金的预言更像是一记警钟,提醒我们在拥抱技术革新的必须保持清醒与谨慎。只有通过全社会的共同努力,确保AI在公共数据的驱动下向善发展,我们才能避免预言成真,真正实现科技与人类的和谐共生。

如若转载,请注明出处:http://www.lazbhkeji.com/product/12.html

更新时间:2026-05-25 05:05:57